神経学的ブレークスルー:脳コンピューターインターフェイスにより、麻痺患者のリアルタイムスピーチを可能にします

重度の麻痺患者の画期的な進歩において、カリフォルニア大学、バークレー校とサンフランシスコ大学は、脳信号をリアルタイムで可聴スピーチに変換する革新的な技術を開発しました。この革新的Brain-Computer Interface(BCI)テクノロジー話す能力を失った人々が自然なコミュニケーション能力を取り戻すのを助ける上で、重要なマイルストーンをマークします。

ストリーミングアプローチは、応答時間を劇的に短縮します

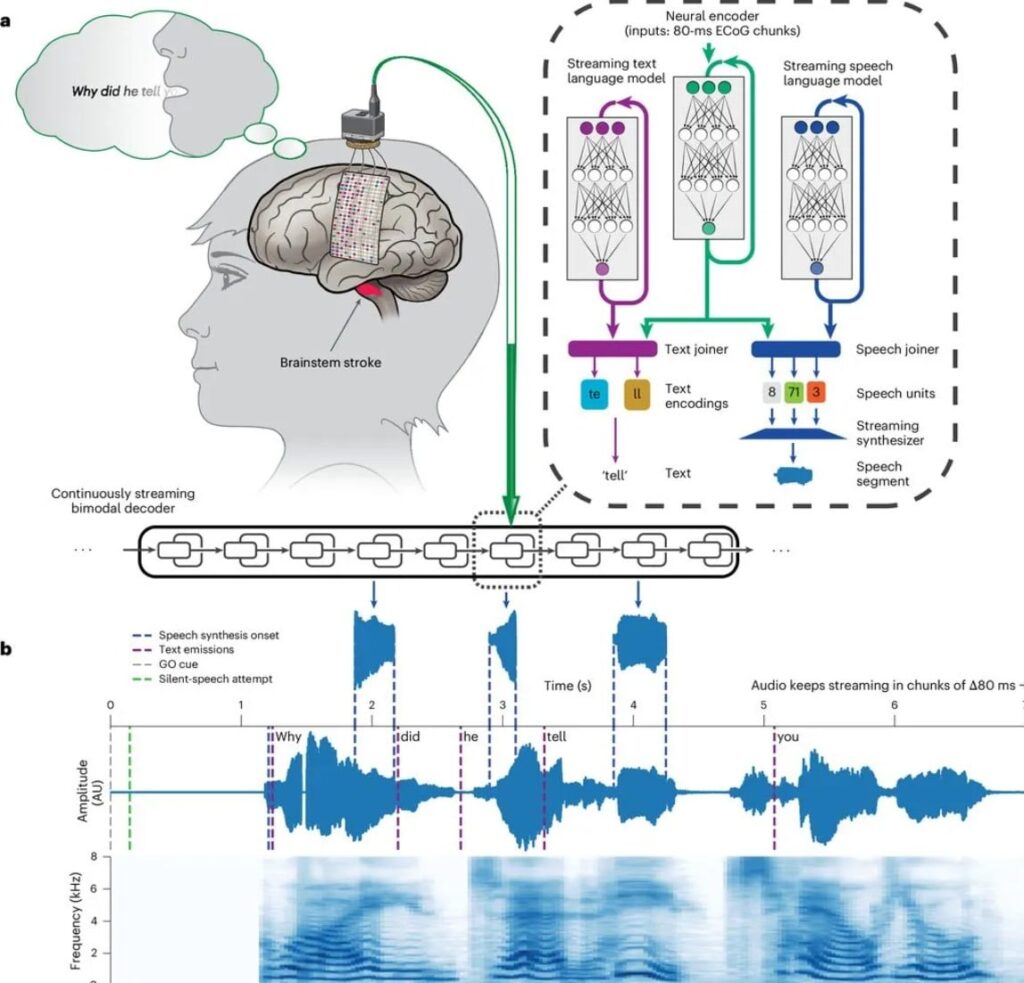

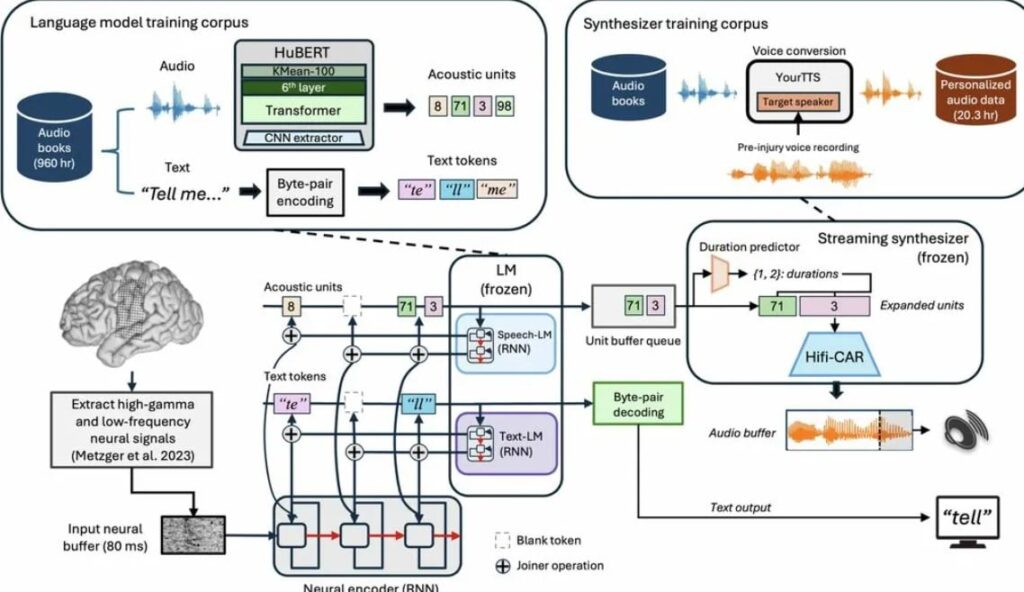

に公開された記事によるとUCバークレーエンジニアリングウェブサイトでは、研究チームが作成しました信号を解読するAI駆動型システムから直接脳の運動皮質、ほぼ瞬時にスピーチを生成します。これ "ストリーミング」アプローチは、以前の方法よりも劇的な改善を表しています。

「AlexaやSiriで使用されているものと同様の音声デコード技術を活用するストリーミングアプローチは、脳の意図から音声出力まで劇的に時間を短縮できます」と、カリフォルニア州バークレーの電気工学およびコンピューターサイエンス省の研究の共同リーダーであるGopala Anumanchipalliは説明します。

この影響速度の向上は注目に値します。新しいテクノロジーの中心にある従来のBCI音声デコードのレイテンシの問題。一方、以前の手法はそれについて必要でした1つの文をデコードするには8秒、新しい方法は、内部の最初の音節を出力できます1秒患者が話すつもりだった後。

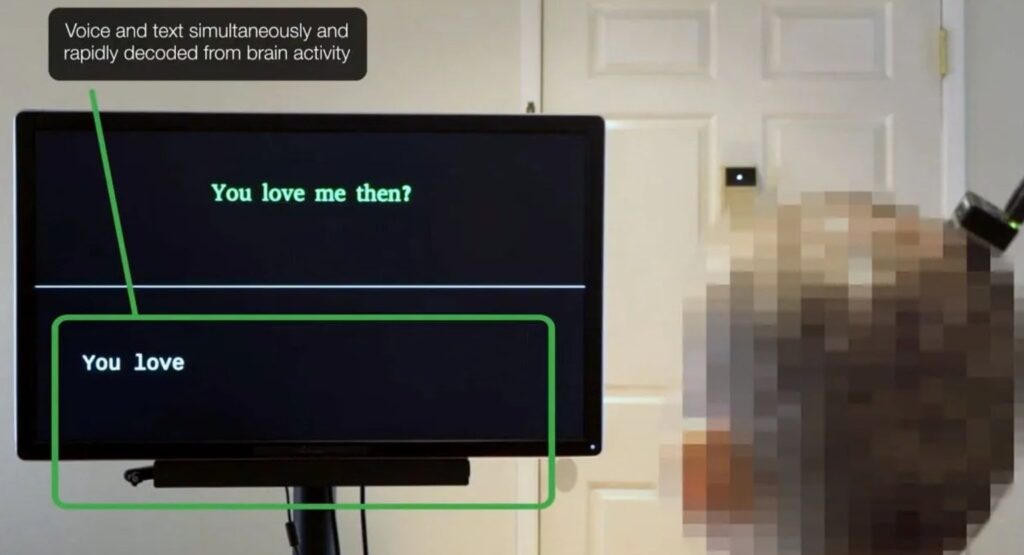

実世界の結果:患者アンの経験

この技術の有効性は、アンとして特定された患者との仕事を通じて実証されました。アンは、発声なしで「考える」文章によって、自然に近いスピーチを生成することができました。

チームの音声生成に対する革新的なアプローチは、このテクノロジーを特に個人的なものにします。Kaylo Littlejohn、研究の共同著者であり、バークレー大学の博士課程学生、チームはAnを使用したと言いましたAi-Preatrained Text-to-Speechモデル患者の負傷前の声をシミュレートして、出力をよりパーソナライズします。

汎用性と適応性

この研究は、微小電極アレイやフェイシャルEMGセンサーを含むさまざまな脳信号取得装置間の印象的な互換性を実証しており、さまざまな臨床環境における広範な潜在的アプリケーションを示しています。

おそらく最も印象的なことに、このシステムは顕著な一般化能力を示しています。患者のアンが「話す、「26の単語はトレーニングデータに含まれていませんでした。特に、「アルファ」のようなNATO音声アルファベットからの単語「ブラボー。」モデルは彼女の意図を正確に解読しました。

「これは、私たちのシステムがパターンのマッチングに依存するだけでなく、実際に音声の構成ルールを学ぶことを証明しています、」メモCheol Jun Cho、別の共同著者および博士課程の学生。 「この能力は、音、ピッチ、および音声表現のその他の特性の将来の改善の基礎を築きます」

将来の方向

患者のアンは、この新しいアプローチが2023年の初期の実験的経験よりも彼女に大きなコントロールと自己表現を与えると報告しています。

楽しみにして、研究チームは、より広範な臨床シナリオのアプリケーションを探索しながら、音声の自然さと感情的表現を強化するためにアルゴリズムを改良することを計画しています。

このニューラルインターフェイステクノロジーは、支援通信技術の大幅な進歩を表しています。怪我や病気でそれらを失った人に、スピーチのような基本的な人間の能力を回復するために、人工知能をどのように活用できるかを示しています。

H2Sは、最新のテクノロジー開発に情熱を傾けているハイテク愛好家のグループです。彼らは常に自分の技術的な問題を解決し、このウェブサイトを通じて他の人と同じソリューションを共有するのが好きです。